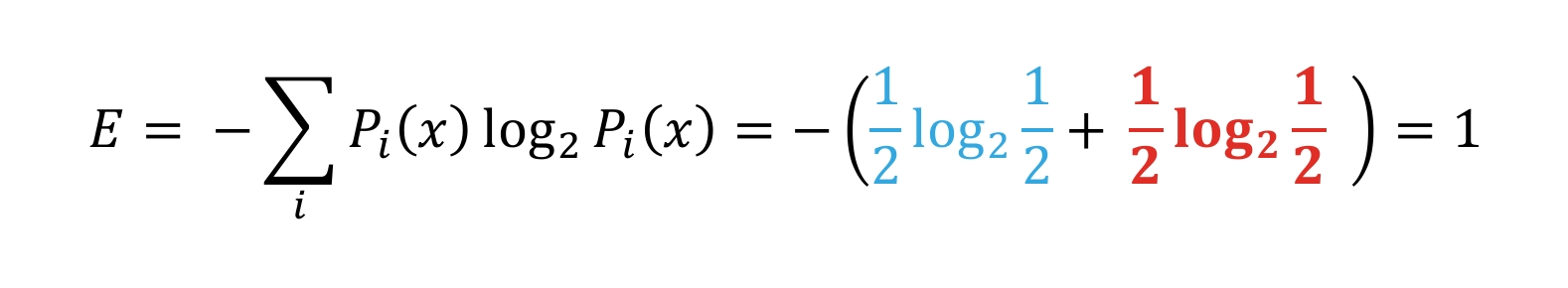

O conceito de entropia permeia diversas áreas do conhecimento e foi introduzido na Teoria da Informação por Claude Shannon, que desenvolveu uma forma de calcular a entropia E de um sistema, a saber Pi(x) em que Pi(x) é a probabilidade do i-ésimo resultado para a variável x. Por exemplo, considere uma sequência com duas letras A coloridas, a primeira azul e a segunda vermelha. Se essas duas letras fossem colocadas numa urna, a probabilidade de se retirar, sem observar, a letra azul, como na sequência original, é 1/2. Devolve-se a letra à urna e sorteia-se novamente. A probabilidade de sair vermelha é novamente 1/2, e nesse caso tem-se:

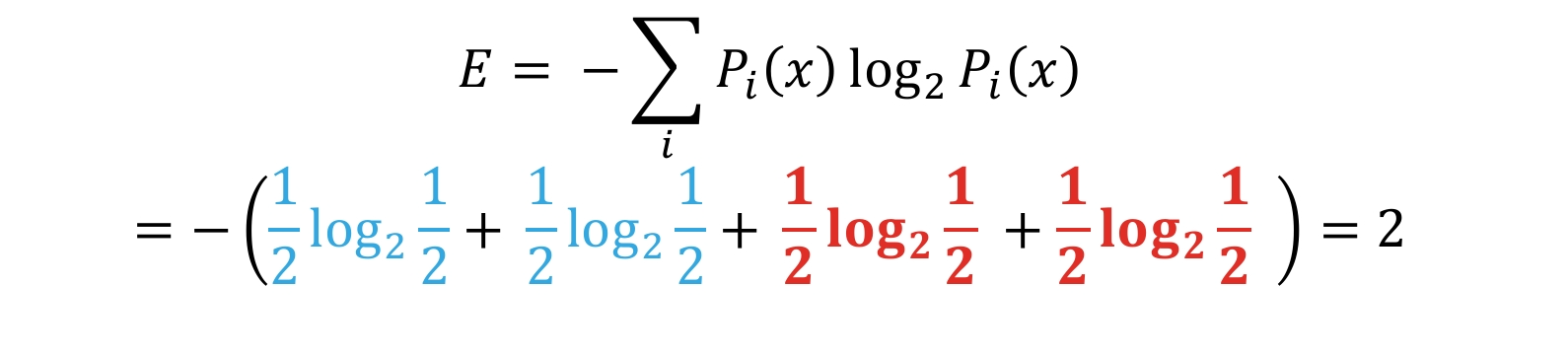

Para uma sequência com 4 letras A, as duas primeiras azuis e as duas últimas vermelhas, colocando-as numa urna e sorteando uma, a probabilidade de sair azul é 1/2. Devolve-se a letra e sorteia-se novamente. A probabilidade da segunda letra sorteada ser azul, como na sequência original, é novamente 1/2. Procedendo dessa forma para as duas letras vermelhas, tem-se:

Com base nessas informações, qual o valor da entropia E, no caso de uma sequência com 4 letras A, sendo as 3 primeiras azuis e a última vermelha?

Resolução passo a passo com explicação detalhada

Matemática > Estatística e Probabilidade > Cálculo de Probabilidades

Cálculo de Probabilidades aparece em ~4% das questões de Matemática (1243 questões no banco).

UERJ 2026

Questão 34

Uma urna contém cinco bolas numeradas de 1 a 5, que serão sorteadas por duas cri

UERJ 2026

Questão 34

Em um grupo de 40 pessoas adultas, 18 têm mais de 50 anos e 25 têm curso superio

Albert Einstein 2026

Questão 42

Patrícia tem dois aplicativos para sortear um número de 1 a 8. Um dos aplicativo

UFRGS 2026

Questão 75

NESTA PROVA, SERÃO UTILIZADOS OS SEGUINTES SÍMBOLOS E CONCEITOS COM OS RESPECTIV